Au début des années 2000 j’avais développé pendant mes temps de loisirs le prototype d’une application mobile (midlet) “Kuck de Radio – LUXGSM 3Glive. A l’époque on ne parlait pas encore de smartphones et JAVA micro édition (J2ME) était la seule plateforme qui permettait de créer des programmes pour mobilophones. Nokia dominait le marché des mobilophones et une partie des appareils était équipée d’une radio FM.

L’idée de “Kuck de Radio” était de transmettre des textes et images via le service GPRS – LUXGSM pour illustrer le contenu radio. Il s’agissait donc d’une évolution du service RDS destiné essentiellement aux automobilistes. Les figures qui suivent montrent quelques exemples des informations transmises, elles ont été assemblées dans le petit diaporama dans la chronologie (timeline).

Les figures qui suivent montrent l’affichage de l’application avec les menus afférents sur l’écran d’un mobilophone Nokia 6680 introduit sur le marché en 2005.

L’application a été présentée aux responsables de RTL à l’époque, mais les réactions étaient mitigées. Dans la suite un ingénieur de Hewlett Packard avait manifesté son intérêt pour faire évoluer le système. Toutefois l’apparition des premiers smartphones avec écran tactile en 2005, suivie du premier iPhone présenté par Apple en 2007 et l’évolution du GPRS vers EDGE et UMTS avec des débits plus élevés pour la transmission de données, le projet “Kuck de Radio” était rapidement dépassé et fourré dans un fond de mes tiroirs.

De tout temps, l’homme cherche à reproduire son image. Jusqu’au XVIIIème siècle, c’était par la peinture et la sculpture que les artistes représentaient le corps humain. Avec l’art de l’horlogerie s’ajoutait la création des automates qu’on appelait androïdes quand ils étaient à figure humaine. Les plus connus sont les têtes parlantes de l’abbé Mical. Deux cent ans plus tard les automates sont devenus virtuels.

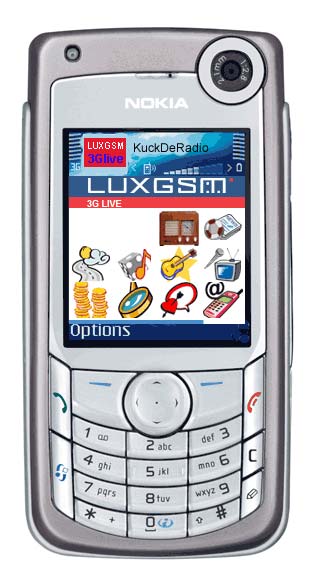

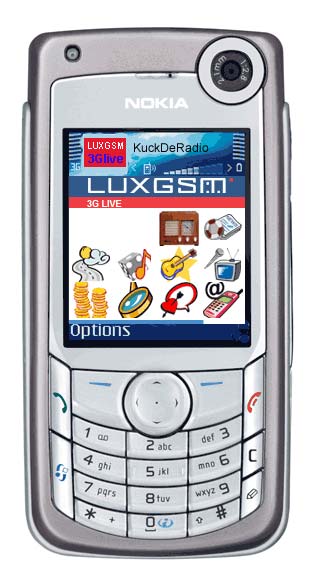

Vers la fin des années 1990, des applications pour créer des têtes parlantes sur le web faisaient légion. Haptek, Mendel3d, Famous3D, LifeX, Crazy Talk, avTalk, ne sont que quelques exemples des produits qui permettaient à l’époque de créer des têtes virtuelles en 3D à partir de deux photos de son visage, de front et de profil. Le programme le plus évolué était 3DmeNow de la société anglaise BioVirtual. Il permettait de créer des têtes parlantes photo-réalistes et de faire des animations faciales synchronisées avec sa propre parole. Ma propre tête parlante est montrée dans la petite vidéo ci-jointe.

Les objectifs de création de têtes parlantes en trois dimensions étaient multiples: personnalités pour les jeux vidéo, réduction de bande passante dans la visiophonie, études des interactions sociales. Parmi les auteurs de bouquins sur le sujet il convient de citer “Creating the Illusion of Personality : Virtual Humans” de Peter Plantec, avec un avant-mot de Ray Kurzweil ainsi que “Animating Facial : Features & Expressions” de Bill Fleming et Darris Dobbs.

La figure qui suit montre l’interface de l’outil FaceWorks créé en 1997 par Digital Equipment Corporation.

Liens :

Une puce à ADN est un ensemble de molécules d’ADN fixées en rangées ordonnées sur une petite surface qui peut être du verre, du silicium ou du plastique. Le principe de la puce à ADN repose sur la propriété que possède l’ADN dénaturé de reformer spontanément sa double hélice lorsqu’il est en présence d’un brin complémentaire. Les quatre bases nucléiques de l’ADN (Adenine, Guanine, Cystosine, Thymine) ont en effet la particularité de s’apparier deux à deux par des liaisons hydrogène

Ma fille a utilisé des puces ADN Agilent SurePrint G3 dans le cadre d’un projet de recherche réalisé à Boston à la Harvard Medical School, Pulmonary and Critical Care Medicine, Brigham and Women’s Hospital, en 2011-2012.

Les spectrogrammes sont des diagrammes représentant le spectre d’un phénomène périodique, associant à chaque fréquence une intensité ou une puissance. L’échelle des fréquences et celle des intensités ou puissances peuvent être linéaires ou logarithmiques. Pour transformer des données discrètes du domaine temporel dans le domaine fréquentiel, on utilise la transformation de Fourier rapide (FFT).

Les spectrogrammes permettent une représentation visuelle de la parole. On voit quasiment la parole. Inversément, on peut également convertir une image intégrée dans un spectrogramme en sons, mais les paroles générées ainsi ne sont généralement pas compréhensibles.

Emoji est le terme japonais pour désigner les pictogrammes utilisés dans les messages électroniques et les pages web. Les émojis sont régis par le consortium Unicode dont le standard est à la version 11 en juin 2018. Les créateurs des navigateurs et applications du web dessinent chacun sa propre version d’un emoji défini par Unicode. L’ensemble des emojis est présenté dans la médiathèque Wikimedia Commons et sur emojipedia.org. En juin 2018 Google a modifié le dessin de l’émoji « salade » en supprimant le petit bout d’œuf qui garnissait jusque là la salade et les tranches de tomates, ce qui a provoqué une vague de réactions des internautes.

Dans le passé c’était l’émoji d’un hamburger qui avait fait scandale parce que le fromage n’était pas à la position correcte. Plus de détails sur l’évolution du codage des caractères et les emojis sont fournis dans ma contribution Evolution of character encoding.

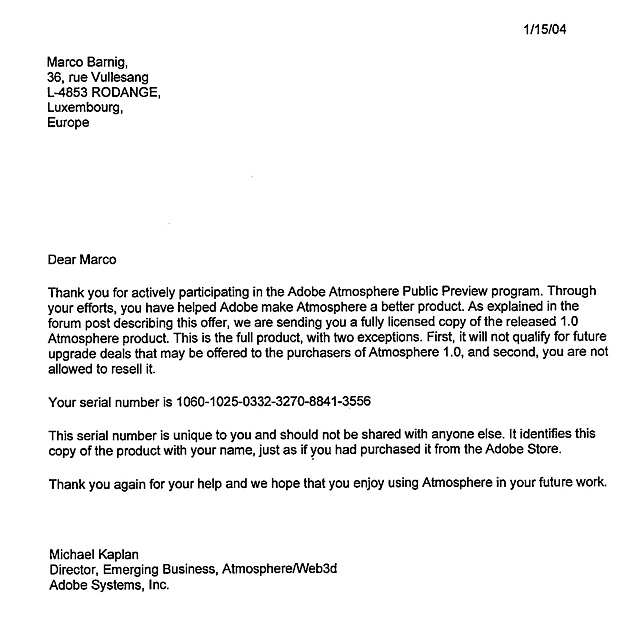

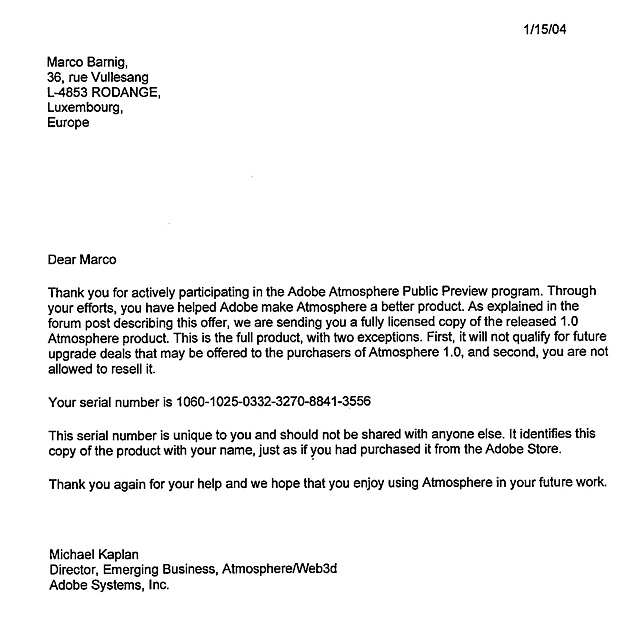

Bien avant SecondLife et les autres mondes virtuels en 3D, Adobe avait démarré en début 2001 une phase de test beta à couverture mondial de son système 3D interactif pour le web, appelé Atmosphere. Ce logiciel de création d’univers virtuels en 3D a été développé à l’origine par Attitude Software et utilisait la technologie de streaming 3D de Viewpoint. J’ai été le premier amateur 3D à créer son propre monde virtuel sur mon site web hébergé par P&T Luxembourg et à le présenter à la communauté des développeurs Atmosphere. C’était le mercredi 28 mars 2001 à 5h42am (pacific time), deux jours après le lancement de la phase de test beta.

Plus d’informations sur Adobe Atmosphere sont fournies sur mon blog dans la contribution La 3D débarque sur le web!.

Atmosphere a passé la majorité de son existence en version bêta, car ce n’est qu’en février 2004 que Adobe présentait la première version (build 216) de son nouveau produit pour le web 3D émergent. Michael Kaplan, un des directeurs d’Adobe à l’époque, m’avait remis une copie personnelle de cette première mouture. La copie de la lettre afférente est présentée ci-après.

adobe-atmosphere

Malgré les avances technologiques de cet outil de création de mondes virtuels en 3D, le produit Adobe Atmosphere n’a jamais connu un vrai lancement commercial et a été abandonné le 19 décembre 2004.